llm-d CNCF 沙箱完整指南 — Kubernetes 原生分布式 LLM 推理框架。

在阿姆斯特丹举行的 KubeCon Europe 2026 上,IBM Research、红帽和 Google Cloud 联合将 llm-d 作为沙箱项目捐赠给 CNCF。

llm-d 是一个分布式推理框架,由 NVIDIA、CoreWeave、AMD、Cisco、Hugging Face、Intel、Lambda 和 Mistral AI 等创始合作伙伴支持,旨在在 Kubernetes 上以生产规模运行大型语言模型 (LLM) 推理。

如果您使用 vLLM 提供模型或使用 KServe 托管推理端点,您可能会感受到其中的差距:vLLM 功能强大,但作为单个 Pod 会遇到扩展障碍,而 KServe 提供高级抽象,但缺乏推理感知路由。

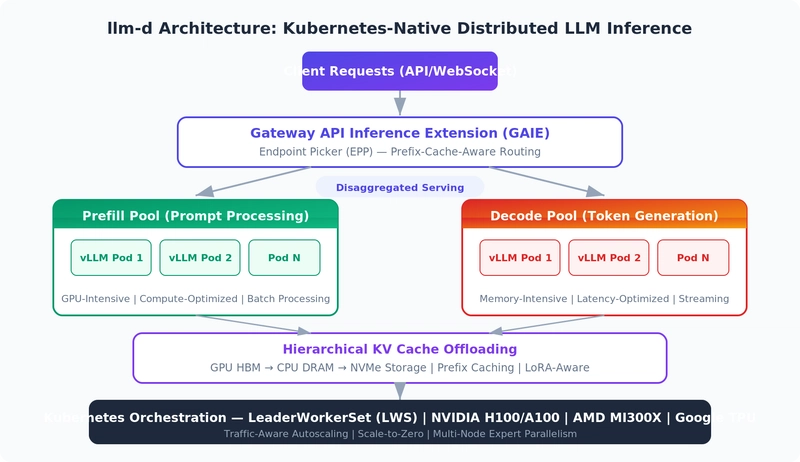

llm-d 作为中间件层恰好填补了这一空白,提供分解服务、分层 KV 缓存卸载和前缀缓存感知路由——所有这些都是 Kubernetes 原生的。

解码(令牌生成)是内存带宽密集型的 — 在同一 Pod 中运行时,GPU 利用率上限为 40-60%。

来源:Dev.to